Hören Sie sich diesen Beitrag an:

Teil 28: KI-Regulierung als Zwickmühle - am Beispiel der Schweizer Medien - VISCHER | Podcast on Spotify

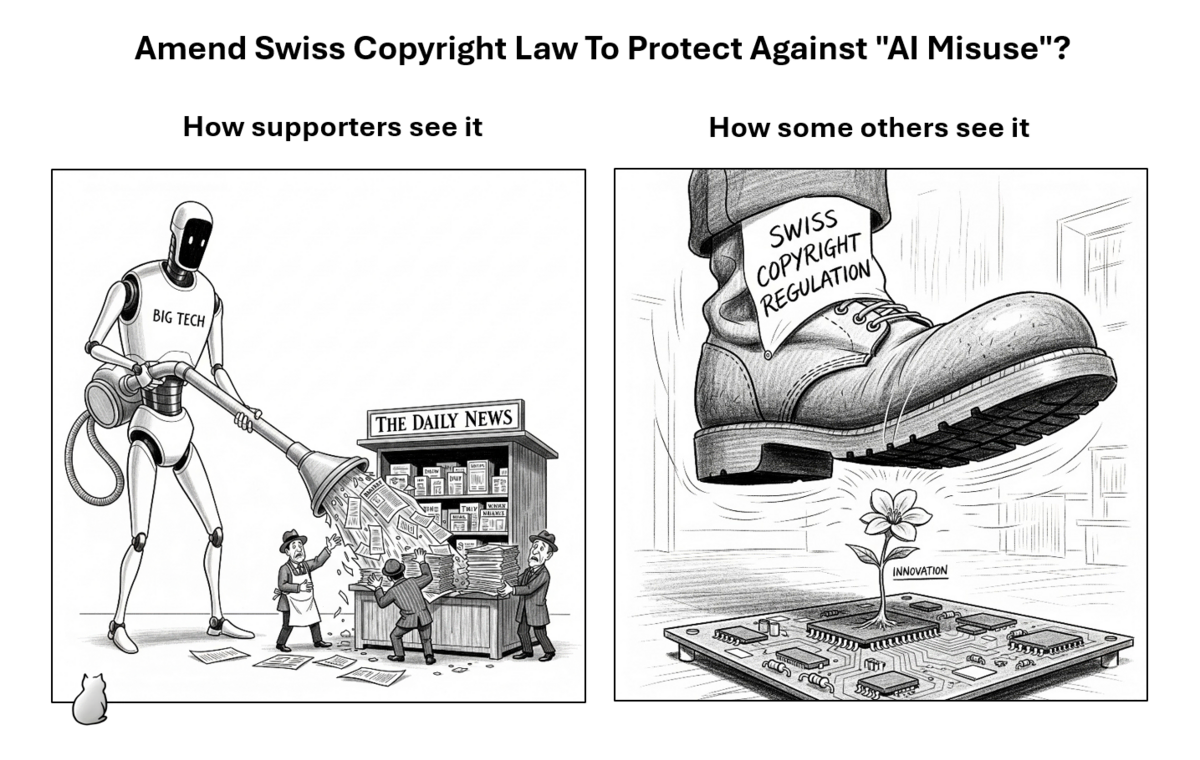

Die Schweizer Medien fürchten um ihre Zukunft, weil KI-Anbieter wie OpenAI, Perplexity und Google ihre Inhalte für ihre eigenen Angebote nutzen und ihren Online-Verkehr unterwandern. Eine Motion im Parlament will dem vermuteten "Missbrauch" nun mit einer weitreichenden Verschärfung des Urheberrechts im Bereich KI einen Riegel vorschieben und hat bereits die erste Kammer passiert. Doch der Vorstoss rüttelt an den Grundfesten des Urheberrechts, indem er nicht mehr nur die konkrete Ausgestaltung von Werken schützen, sondern auch die darin enthaltene Information für KI-Anbieter dem Urheberrecht unterstellen will. Damit würde eine zentrale Schranke des Urheberrechts abgeschafft. Kommt die Motion durch und setzt sie der Bundesrat auch um, droht nach Ansicht von Kritikern ein faktisches Verbot mancher KI-Dienste in der Schweiz. Die Befürworter sehen das völlig anders: Sie erhoffen sich dadurch Verhandlungsmacht, um ein faires Entgelt für die Nutzung ihrer Inhalte zu erhalten. Um ein Verbot geht es ihnen nicht und so sei die Motion auch nicht gemeint. In Teil 28 unserer Blog-Serie zum Thema KI erläutern wir an diesem Beispiel, wie trickreich KI-Regulierung sein kann – und wie gefährlich, wenn vorschnell in bestehende Regelungskonzepte eingegriffen wird, um den Leidensdruck einzelner Branchen zu reduzieren. Schon an der Frage, ob es sich bei der Verwendung solcher Wekre durch KI-Anbieter wirklich um Missbrauch handelt, scheiden sich die Geister. Auch sonst sind die Gräben tief und die Angelegenheit emotional. Dabei gäbe es konsensfähige Lösungsansätze ohne Gefahr eines Eigentors für die Schweiz, wie etwa ein Opt-out-Recht für Rechteinhaber oder eine kollektive Vergütungsregelung über Verwertungsgesellschaften. Wir wagen uns in diesem Minenfeld an eine Auslegeordnung.

Ein vermeintliches, ein echtes und ein erwünschtes Problem

Die Ausgangslage ist in der Praxis nicht umstritten: Nachdem die traditionellen Medien in Bezug auf das Online-Werbegeschäft immer stärker unter Druck der Geschäftsmodelle von Google, Meta und Co. geraten sind und immer mehr Werbeumsatz an letztere verlieren (siehe die Analyse hier), erleiden sie nun zunehmend auch noch Einbussen wegen künstlicher Intelligenz. Genauer gesagt sind es vor allem zwei Probleme:

- Problem Nr. 1: Es besteht darin, dass viele der bekannten Anbieter von grossen Sprachmodellen alle möglichen Inhalte aus dem Internet – darunter auch von Schweizer Medien – für das Training dieser Large Language Models (LLM) verwenden. Sie profitieren mit anderen Worten vom Sprach- und Faktenwissen, das (auch) aus Medienpublikationen gewonnen werden kann. Soweit der Grundsatz. Dieser muss allerdings differenziert werden. So ist der Anteil von Schweizer Medien im Verhältnis zur gesamten, gesammelten Datenmenge verschwindend klein. Eine Studie unter Schweizer Mitwirkung zeigte zudem, dass im Internet mit einem Crawler-Opt-out publizierte Inhalte für die Performance eines LLM jedenfalls im Bereich des Allgemeinwissens mehr oder weniger irrelevant sind (siehe hier; bei hochspezialisierten Themen wie der biomedizinischen Forschung ist es anders, wenn die grossen Verlage ausgeschlossen werden). Im Umkehrschluss stellt sich also die Frage, ob solche Inhalte mit Opt-outs wirklich zur Wertschöpfung eines Sprachmodells beitragen, selbst wo Inhalte geschützt sind. Wir erwähnen dies deshalb, weil Schweizer Medien regelmässig solche Opt-outs setzen und es bei der Frage der angemessenen Abgeltung, um die es im Kern geht, natürlich darauf ankommt, was der wirtschaftliche Beitrag am Ergebnis ist; dazu später noch mehr.

- So oder so: Nach Schweizer Recht ist die Verwendung solcher Inhalte für das Training – jedenfalls wenn auf öffentlich frei zugängliche Inhalte zugegriffen wird und sofern gewisse Voraussetzungen erfüllt werden – grundsätzlich legal, mitunter selbst bei einem Crawler-Opt-out (siehe dazu ausführlich hier). Urheberrechtlich problematisch werden kann es aber insbesondere dann, wenn Sprachmodelle geschützte Inhalte aus dem Training in ihrer ursprünglichen Form wiedergeben (darum dreht sich beispielsweise der bekannteste laufende Gerichtsprozess der New York Times zum Thema, siehe hier), was Entwickler von KI-Modellen in der Regel auf verschiedene Weise zu verhindern versuchen. Wenn ein KI-Bot Inhalte unter Umgehung einer (technisch tatsächlich wirksamen) Paywall auf der betreffenden Website sammelt, etwa indem er sich "reinhacken" würde, könnte dagegen grundsätzlich ebenfalls rechtlich vorgegangen werden: Die für das KI-Training häufig angerufene "Forschungsausnahme" des Schweizer Urheberrechts (Art. 24d URG) greift zum Beispiel nur, wenn ein "rechtmässiger" Zugang zu den Inhalten besteht. Selbst wenn ein solcher nur angenommen würde, weil der KI-Bot ein Abo nutzt, aber gegen die vereinbarten Bedingungen verstösst (die Abos verbieten regelmässig ein Crawlen), könnte wegen Vertragsverletzung und allenfalls aufgrund eines Verstosses gegen das Lauterkeitsrecht vorgegangen werden, selbst wenn das Urheberrecht keine Handhabe böte. Je nach Konstellation kann ein strafbares Erschleichen einer Leistung vorliegen oder eine strafbare unbefugte Datenbeschaffung. Die tatsächliche Durchsetzung dieser Regelungen ist jedoch hürdenreich und daher mitunter nicht praktikabel. Dies jedenfalls aus Sicht der Schweizer Medien, die hier offenbar keine Handhabe sehen.

- Ob Zugriffe auf Inhalte hinter der Paywall wie beschrieben tatsächlich auch in der Schweiz passieren, ist umstritten. So macht die NZZ geltend, dies sei bei einem Text des Einsiedler Anzeigers geschehen, während der Zürcher IT-Anwalt Martin Steiger der NZZ vorwirft, einen "Datenklau" durch Perplexity AI zu erfinden (siehe hier). Tatsächlich erscheint der fragliche Beitrag kurz und ist damit für Bots der KI-Anbieter faktisch zugänglich, wird dann aber sofort abgedeckt, damit ihn menschliche Nutzer nur mit Abo lesen können. So kann gestritten werden, ob hier rechtlich tatsächlich eine Paywall umgangen wird, oder ob sie einfach technisch zu wenig konsequent umgesetzt wurde, so dass KI-Anbieter diese quasi gar nicht "erkennen", weil sie den Artikel eben – anders als menschliche Nutzer – bereits in dieser ersten Sekunde, bevor die Paywall erscheint, "gelesen" haben. Freilich gibt es auch die Möglichkeit, Paywalls indirekt zu umgehen, indem die bei der Quelle geschützten Inhalte kurzerhand an anderen, frei zugänglichen Orten gesammelt und wenn nötig zusammengestückelt werden. Der KI-Bot rekonstruiert also gewissermassen aus Zitaten, Ausschnitten oder Kopien in Drittarchiven (siehe dazu hier) den gewünschten Artikel und setzt ihn so zusammen (siehe dazu hier, welcher Bericht übrigens seinerseits ein frei zugänglicher Bericht ist, der einen hinter einer Paywall stehenden Bericht der FAZ zusammenfasst und die dortige Rechercheleistung somit frei zugänglich macht). Für ein KI-Training dürfte dies unter der Forschungsausnahme benutzt werden, wenn der Zugang zu den einzelnen Werken jeweils rechtmässig war, eine wörtliche Wiedergabe eines geschützten Artikels erlaubt aber auch die Forschungsausnahme nicht; sie will nur die Entnahme von Informationen zu Forschungszwecken – wozu auch das Training eines KI-Modells gehört – schützen (siehe hier). Genau um diese Differenzierung geht es übrigens auch im Streit der New York Times, d.h. um die Wiedergabe von Artikeln, die mutmasslich auf Drittseiten gesehen wurden. Dass wiederum gegen Dritte, die Quellen wortwörtlich wiedergeben, durchaus rechtlich vorgegangen werden kann, zeigen entsprechende Verfahren (siehe hier).

- Was bei diesem Thema betreffend KI-Training allerdings häufig unbeachtet bleibt ist der Umstand, dass das reine Training von KI-Modellen mit längst erschienenen Inhalten die Schweizer Medien selbst nach Aussagen aus den eigenen Reihen kaum zu schmerzen scheint, jedenfalls wenn es nicht zur Wiedergabe der Artikel kommt (was technisch bei Modelltrainings nur bei einem Beitrag geschehen kann, der im Training genügend oft gesehen und dadurch quasi als Ganzes memorisiert wird). Es schränkt den Verkehr auf ihren Seiten kaum ein und die Wertabschöpfung durch Dritte ist minim bis theoretisch. Natürlich würden sich die Verlage freuen, auch für solche Nutzungen ein Entgelt zu erhalten. Allerdings wäre dieses ebenfalls minim bis vernachlässigbar. Darum ist der Vorgang des Trainings grosser Sprachmodelle nicht wirklich ein Problem. Auf die Rechtslage beim klassischen KI-Training kommt es für die Rechteinhaber also – überspitzt gesagt – wirtschaftlich nicht gross an. Hinzu kommt die Erkenntnis, dass der Schutz, den das Recht zu erbringen mag, hinter das zurückfällt, was in den erwähnten Fällen eine technisch zuverlässige Sperre gegen datenhungrige Bots leisten kann und wie Kopien der eigenen Artikel auf anderen, frei zugänglichen Seiten verhindert werden kann. An dieser Front wird auch in der Praxis investiert – und nicht in juristische Kämpfe direkt gegen die KI-Anbieter, jedenfalls nicht in der Schweiz.

- Problem Nr. 2: Was die Schweizer Medien wesentlich stärker betrifft, ist ein Phänomen, was in der Szene unter anderem unter dem Stichwort "Google Zero" bekannt ist. Es beschreibt ein Schreckensszenario, in welchem der ganze von Internet-Suchmaschinen wie Google auf ihren Online-Angeboten generierte Benutzerverkehr auf Null schrumpft, weil die Benutzer bereits mit den Zusammenfassungen zufrieden sind, die ihnen die KI von den Artikeln und weiteren Inhalten ihrer Online-Angebote liefern. Hierbei wird auf bereits heute massiv reduzierten Internet-Verkehr verwiesen. So sollen Googles "AI Overviews" diesen Web-Verkehr bereits um 34 Prozent reduziert haben (siehe hier, hier und hier). Eine andere Ausprägung sind Chatbots wie ChatGPT oder Perplexity, die wiederum klassische Suchmaschinen wie die von Google angreifen, indem sie Benutzern anbieten, für sie im Internet suchen zu gehen. Die Tech-Firmen graben sich also auch gegenseitig das Wasser ab. Diese Einbussen bei den Content-Lieferanten am Ende der Kette werden durch die Weiterempfehlungen seitens der KI-Angebote (wo der Benutzer die Quellen der Zusammenfassungen anklicken kann, falls er sich tatsächlich interessiert, was diese Klicks dann an sich viel wertvoller machen sollte) offenbar in keiner Weise aufgewogen – hier geht es um Masse, nicht einige wirklich interessierte Leser. Weniger Benutzerverkehr bedeutet jedenfalls für gewisse Medienangebote weniger Werbeeinnahmen. Dies – und nicht das Training von KI-Modellen – ist aus Sicht der Schweizer Medien die echte Bedrohung.

- Rechtlich haben sie gegen solche Aktivitäten in der Schweiz, wie gesagt höchstens dann etwas in der Hand, wenn auf Inhalte hinter einer (wirksamen) Paywall direkt zugegriffen wird oder natürlich, wenn im Output mehr als Zusammenfassungen, Zitate oder kurze Ausschnitte erscheinen (siehe oben). Ein Opt-out-Signal auf der Website, selbst wenn maschinenlesbar, genügt im bestehenden Schweizer Recht allerdings in der Regel nicht, um Bots rechtswirksam von ansonsten öffentlichen Inhalten abzuweisen. Praktisch tut es das sowieso oft nicht: Ein bekannter Schweizer Zeitungsverlag zählte nach seinen Angaben kürzlich pro Woche einige Tausend Zugriffe von Bots auf seiner Zeitungs-Website, wobei nach ihrer Angabe 98% der Zugriffe das maschinenlesbare Opt-out ignorierten.

- Dies gesagt, ist auch hier eine Differenzierung nötig: Erstens gibt es sehr viele verschiedene Arten von Bots, und nur ein Teil davon hat mit KI-Trainings zu tun. Zweitens wollen Medienhäuser in manchen Fällen und sind wirtschaftlich darauf angewiesen, dass ihre Inhalte von Bots gescannt werden – unter Umständen sogar hinter der Paywall, damit sie z.B. in Internet-Suchdiensten vorkommen und gefunden werden, Benutzer draufklicken und sie dann hoffentlich kaufen. Bots sind also nicht nur ein Problem, und sie mit der "robots.txt"-Datei generell auszuschliessen ist keine befriedigende Lösung. Es ist in der Tat auch kein Widerspruch, den Zugang für traditionelle Suchmaschinen, die Traffic generieren, zu erlauben, während er für KI-Anwendungen, die Inhalte substituieren, verweigert wird. Wenn aber Suchdienste immer stärker zu KI-Diensten werden, entsteht trotzdem eine Zwickmühle, weil sich einerseits die Suchgewohnheiten des Publikums verändern, und gewisse Tech-Anbieter die Differenzierung technisch oder vertraglich gar nicht ermöglichen oder die Medienhäuser keine ausreichende Verhandlungsmacht haben, um eine solche selektive Zustimmung durchzusetzen.

- Auch hier ist eine Differenzierung erforderlich: Der Branchenprimus Google ist, wie selbst Medienvertreter einräumen, mittlerweile eine Ausnahme, da er Betreibern von Webseiten technische Tools zur Verfügung stellt, mit welchen diese bestimmen können, ob ihre Inhalte für KI-Training oder Internet-Suchen von KI-Modellen (sog. Grounding) benutzt werden können, ohne dass die Auffindbarkeit dieser Inhalte in der normalen Suche tangiert ist (siehe hier und hier). Diese Techniken müssen aber von den Website-Betreibern genutzt werden. Vertreter der Medienbranche betonen wiederum, dass es auch ihnen nicht um ein Verbot von solchen KI-Angeboten geht, sondern um eine faire Abgeltung für ihre Inhalte. Es geht ihnen also – wohl mit Ausnahme der auf Drittseiten zusammengestückelten Beiträge – nicht um Diebstahl oder "Missbrauch" von geistigem Eigentum, sondern um das Schaffen von Verhandlungsmacht, wie sie ihnen beispielsweise das EU-Urheberrecht mit gewissen Opt-out-Regelungen vermittelt, was in der Schweiz bis anhin fehlt.

- Hier sehen sich die Schweizer und auch andere Medien heute im Hintertreffen – sie erhalten bisher noch kaum Deals mit den KI-Anbietern, oder dies nicht zu den Konditionen, die sie sich wünschen; Verträge konnten in der Vergangenheit vor allem die grossen internationalen Verlage abschliessen. Deals für den geregelten Zugang zu qualitativ hochwertigen Inhalten werden allerdings eine Frage der Zeit sein. Der Zankapfel wird dabei vor allem die Höhe des Entgelts sein; die Ansichten werden hier weit auseinandergehen. Hierbei geht es zudem nicht nur um KI, sondern beispielsweise auch den Preis für Ausschnitte aus Texten, für deren Wiedergabe Anbieter wie Google in der EU bezahlen müssen. Das ist jedoch ein Thema für sich, das in der Schweiz unter dem Titel des sog. "Leistungsschutzrechts" ebenfalls diskutiert wird und auf das hier nicht eingegangen werden soll (siehe hier). Die hier laufende Gesetzesrevision könnte immerhin Basis für eine Anpassung auch von Regeln zum Thema KI werden, doch dazu später mehr.

Selbstverständlich gibt es neben den Schweizer Medien noch andere Kreativschaffende, die sich durch KI bedroht fühlen – und darüber hinaus auch diverse andere Berufsgruppen. Sie geraten ob dem Fokus auf die Medien oft in den Hintergrund. Sie argumentieren, die KI habe an ihren Inhalten das gelernt, was sie heute kann und boote sie nun mit diesem Können in ihrem Schaffen aus, weil sie Inhalte, die für viele gut genug sind, sehr viel günstiger und schneller produzieren könne als Kreativschaffende. Wie weit hier tatsächlich eine Verdrängung erfolgt, sei an dieser Stelle dahingestellt; die Frage ist freilich für die wirtschafts- und sozialpolitische Debatte, die hier geführt werden sollte, wichtig (dazu sogleich). Zu beachten ist allerdings, dass es – anders als bei den Beispielen der Schweizer Medien – hier auch um (freien) Wettbewerb geht: Schon immer war es so, dass Marktteilnehmer sich von Mitbewerbern inspirieren liessen und es dann besser, billiger oder schneller machen konnten, was oftmals zu einer Verbesserung des Angebotes führte. Wird nicht ein immaterialgüterrechtlich geschützter Inhalt reproduziert und nicht ein marktreifes Arbeitsergebnis ohne angemessenen eigenen Aufwand übernommen und verwertet, ist dieses Verhalten im Schweizer Recht damit grundsätzlich nicht nur erlaubt, sondern gesetzgeberisch gar erwünscht.

Liegt hier wirklich ein Missbrauch vor?

Doch ist es wirklich so einfach – oder gar eine überholte Sichtweise? Zunächst sollten wir uns bewusst sein, dass die Debatte um das Urheberrecht beim Einsatz von KI in der Schweiz jedenfalls ausserhalb von Fachkreisen gegenwärtig noch vorwiegend emotional und pauschal geführt wird. Bei der Nutzung von Medieninhalten durch KI-Anbieter wird beispielweise regelmässig von einem "Missbrauch" gesprochen. Immer wieder ist im Zusammenhang mit KI auch vom "Diebstahl" geistigen Eigentums die Rede, auch in Fällen, wo rechtlich kein solcher vorliegt. Nicht einmal wissenschaftliche Beiträge zum Thema sind vor Hasskommentaren gefeit, etwa wenn die Frage aufgeworfen wird, ob und inwieweit sich ein Lernen einer Maschine vom Lernen beim Menschen urheberrechtlich unterscheidet, wenn es die Maschine und den Menschen in die Lage versetzt, neue Inhalte zu erschaffen. Solche Fragen treffen also einen Nerv und müssen daher auch ohne Scheuklappen diskutiert werden. So wie beispielsweise auch diskutiert werden muss, ob Dinge, die sich eine KI ausdenkt, sich patentrechtlich schützen lässt und von wem (dazu für die Schweiz hier, wo ein Gericht entschied, dass die KI keine Erfinderin im Sinne des Gesetzes sein kann).

Zum Thema "Missbrauch" sei auch daran erinnert, dass Missbrauch ein Verstoss gegen anerkannte Regeln, Normen oder Gesetze ist, und ob das hier in der Schweiz tatsächlich vorliegt, darüber kann gestritten werden. Welche Regeln für KI im Bereich des Urheberrechts gibt es, die erstens anerkannt und zweitens verletzt sind?

Der Standard, der einigermassen etabliert ist, ist der "Robots Exclusion Standard", bei welchem der Betreiber einer Website mit der Datei "robots.txt" auf seinem Server bestimmen kann, welche Teile seiner Website von einem Roboter abgesucht werden dürfen und welche nicht (siehe hier). Wird das nicht beachtet, kann das auf den ersten Blick also durchaus als Missbrauch betrachtet werden. Doch so einfach ist das nicht unbedingt. So wird ins Feld geführt, dass die Einhaltung des Standards freiwillig sei, er keine Unterscheidung nach Verwendungszweck erlaubt, d.h. es immer um alles oder nichts geht (es können aber spezifische Bots adressiert werden), und er sich nicht auf Rechteinhaber bezieht, sondern Websitebetreiber (was bei den Verlagen freilich keine Rolle spielen mag). Er regelt auch nicht, was mit Inhalten geschehen darf, sondern nur, ob gescannt oder indexiert werden soll. Das ist aber nicht das eigentliche Problem. An einem Standard, der für heutige Verhältnisse taugt, wird erst noch gearbeitet. Vor allem aber sollten wir uns fragen: Gilt der Standard oder sollte er gelten auch für Fälle wie beim Problem No. 2 wo ein einzelner Benutzer einen Computer beauftragt, für ihn eine Websuche durchzuführen und ihm das Ergebnis zusammenzufassen? Oder geht das vom Benutzer verwendete Werkzeug den Betreiber der Website schlicht nichts an? Um diese Fälle ging es bei seiner Entwicklung (ursprünglich 1994) nicht, weil es sie damals gar nicht gab. Liegt demnach auch hier wirklich ein Missbrauch vor?

Das eigentliche Problem erscheint vielmehr zu sein, dass die Gesellschaft hier mit einem neuen Phänomen konfrontiert ist, für welches eben noch nicht klar ist, welche Regeln gelten sollen. Es gilt also, erst zu definieren, was Missbrauch sein soll und zu hinterfragen, ob bestehende Regelungskonzepte – im Urheberrecht oder anderswo – noch fair sind. Diese Frage ist viel komplexer, als es die jeweiligen Lager darstellen. Um die vorliegende Konstellation zu nehmen: Zwar liegt in vielen Fällen keine direkte Kopie eines Werkes vor, doch die zentrale Sorge vieler Rechteinhaber ist der sogenannte Substitutionseffekt: Die Gefahr, dass KI-generierte Inhalte die Originalwerke am Markt ersetzen und deren Wert untergraben. Diese Problematik wird international intensiv diskutiert, insbesondere im US-amerikanischen Recht unter dem Stichwort der "Market Dilution" (Marktverwässerung). Dort befassen sich Gerichte mit der Frage, ob die Nutzung urheberrechtlich geschützter Werke zum Training eines KI-Modells als "Fair Use" gelten kann (und damit erlaubt wäre), wenn dieses Modell anschliessend potenziell unendlich viele konkurrierende Werke erzeugt und so den Markt für die Originale erheblich schädigen könnte. US-Richter haben mitunter zu Protokoll gegeben, dass eine Technologie, die gleichzeitig hochgradig transformativ ist (also eben keine blossen Kopien erstellt und damit Urheberrecht in den USA grundsätzlich nicht verletzt), aber auch das Potenzial hat, den Markt für die zugrundeliegenden Werke massiv zu verwässern, eine neuartige Herausforderung für das Urheberrecht darstellt. Das ist kein Missbrauch, sondern eine Herausforderung, die politischer Entscheide über etwaige Systemänderungen bedarf – und eine entsprechende Datenlage. Denn es ist umstritten, wie hoch die Substitutionseffekte tatsächlich sind, also ob – um beim Beispiel Medien zu bleiben – das Publikum statt Medien direkt zu konsumieren auf Services wie ChatGPT oder Perplexity wechselt. Umgekehrt liegt es auf der Hand, dass Benutzer angesichts der immer grösseren Informationsflut Wege suchen, diese zu bändigen – und die KI bietet sich hier an. Und nicht nur dort: KI-Anbieter machen sich daran, die "eyeballs" menschlicher Nutzer ganz generell zu ersetzen. So haben OpenAI und andere Unternehmen bereits Services lanciert, mit denen virtuelle "Agenten" beauftragt werden können, selbstständig Aufgaben im Internet zu erledigen, z.B. für ein Produkt das beste Angebot zu finden – unbeeinflusst von etwaigen psychologischen Tricks der Betreiber der Online-Shops. Auch letztere müssen sich also beispielsweise auf eine neue Realität vorbereiten, wie ganz viele Branchen.

Diese Debatte wirft eine grundlegende Frage auf, die auch für die Schweiz relevant ist: Soll das Urheberrecht im Lichte der technologischen Entwicklung weiterentwickelt werden, um nicht nur die konkrete Werkform, sondern auch vor solchen Substitutionseffekten zu schützen, soweit solche stattfinden und sie als marktverzerrend betrachtet werden müssen? Oder handelt es sich hierbei primär um eine wettbewerbsrechtliche Frage? Und was ist markverzerrend und nicht bloss der gewünschte Gang des Wettbewerbs und der Innovation? Die Tatsache, dass der Substitutionseffekt als zentrales Kriterium für eine mögliche urheberrechtliche Regelung diskutiert wird, kann als Indiz dafür gewertet werden, dass sich das Verständnis des Urheberrechts derzeit im Wandel befindet. Es geht nicht mehr nur um den Schutz vor Piraterie, sondern zunehmend um die Sicherung fairer Marktbedingungen in einer von KI geprägten Informationsökonomie. Das US Copyright Office hat beispielsweise bereits klargestellt, dass kommerzielle KI-Anwendungen, die grosse Mengen geschützter Werke nutzen, um Inhalte zu erzeugen, die mit diesen auf bestehenden Märkten konkurrieren, die Grenzen des "Fair Use" überschreiten könnten (siehe hier und eine Analyse beispielsweise hier).

Die vermeintliche Lösung: Eine Anpassung des Urheberrechts

In der Schweiz findet diese Diskussion leider erst ansatzweise statt. Derzeit wird hier ein anderer Weg eingeschlagen. Eine vermeintliche Lösung für die erwähnten Probleme liegt seit letztem Jahr mit einer Motion gegen den "KI-Missbrauch" auf dem Tisch. Verfasst hat sie die FDP-Ständerätin und Juristin Petra Gössi. Die genauen Umstände der Entstehung der Motion sind nicht öffentlich bekannt. In Fachkreisen wird jedoch vermutet, dass der Verband Schweizer Medien (VSM) eine massgebliche Rolle bei der Initiierung gespielt haben könnte, da der Vorstoss journalistische Inhalte besonders hervorhebt. Der VSM unterstützt den Vorstoss jedenfalls. So oder so: Es geht offenkundig darum, die beiden genannten Probleme der Schweizer Medien zu adressieren, und dies mit dem Holzhammer, wie in Fachkreisen mit Sorge beobachtet wird.

Die Motion verlangt vom Bundesrat, das Urheberrecht wie folgt anzupassen (siehe hier):

- Die Zustimmung der Urheberrechtsinhaber ist notwendig, wenn journalistische Inhalte und weitere originäre Kreativleistungen in irgendeiner Weise für Angebote generativer KI ausgelesen, verarbeitet und wieder angeboten werden - als Verwendungsrechte unter Art. 10 Abs. 2 URG oder der Generalklausel in Abs. 1.

- In den Schrankenbestimmungen (in Art. 19 Abs. 3, ggf. Art. 24a, 24d und 28 URG) ist klarzustellen, dass sich solche öffentlichen Dienste und Angebote nicht auf Ausnahmen oder Schranken des Urheberrechts berufen können.

- Das schweizerische Recht ist anwendbar und die Gerichte in der Schweiz sind zuständig, wenn Inhalte in solcher Weise in der Schweiz angeboten werden.

Die Motion ist für eine solche ungewöhnlich konkret formuliert. Ihre Forderungen sollen so verstanden werden, dass journalistische Inhalte und sonstige vom Urheberrecht erfasste Werke und Leistungen bei der Nutzung durch KI-Anbieter "umfassend Schutz" erfahren. Wird sie angenommen, muss der Bundesrat nach diesen Vorgaben eine Anpassung des Urheberrechtsgesetzes vorschlagen. Darum lohnt es sich, die drei Ziffern genauer zu analysieren.

Schritt 1: GenKI-Angebote benötigen die proaktive Zustimmung aller Rechteinhaber, auch wenn deren Werke nicht ausgegeben werden

Schon bisher ist es so, dass jede Verwendung urheberrechtlich geschützter Inhalte grundsätzlich die Zustimmung des Rechteinhabers benötigt, mindestens solange deren individueller Charakter weiter erkennbar bleibt. Wenn ein KI-Chatbot einen Zeitungsartikel liest und in wesentlichen Teilen wieder ausgibt, ist das schon nach heutigem Recht eine urheberrechtlich relevante Handlung und somit nur mit Zustimmung des Rechteinhabers erlaubt. Besteht keine Ausnahme (sog. Schranke, dazu Ziff. 2) oder eben eine Zustimmung des Rechteinhabers, geht das also nicht. Weil es dafür keine Ziff. 1 bräuchte und dies das Problem der Schweizer Medien nicht besser löst als heute, muss Ziff. 1 weiter interpretiert werden. Diese Annahme wird auch durch die Formulierung "in irgendeiner Weise" gestützt. Diese Wortwahl weist darauf hin, dass eben nicht eine möglichst enge und konkrete Regelung geschaffen werden, sondern diese so breit als nur möglich verstanden werden soll. Auch der Einleitungssatz der Motion verlangt "umfassend Schutz". Daraus folgt, dass die Zustimmung des Rechteinhabers auch dann als nötig angesehen wird, wenn das ursprüngliche Werk im Ergebnis der KI gar nicht mehr erkennbar ist, d.h. wenn ein KI-Service zwar geschützte Inhalte nimmt, sie aber so weitgehend verändert, dass der individuelle Charakter des Ausgangswerkes nicht mehr erkennbar ist und diese dann anbietet. Das widerspricht dem Konzept des Urheberrechts, wonach jeweils nur die konkrete Ausprägung, beim Text also die konkrete Formulierung, geschützt ist, nicht aber die zugrundeliegende Information. Die Motion geht entscheidend weiter: Wird eine Information mittels KI aus einem urheberrechtlich geschützten Text gewonnen, soll auch das darin enthaltene Wissen weiterhin dem Rechteinhaber des Werks gehören, jedenfalls zu Lasten desjenigen, der die KI und damit dieses Wissen anbietet. Dies würde eine Abkehr vom bisherigen Grundsatz des Urheberrechts bedeuten, wonach Ideen und Informationen als solche nicht schutzfähig sind, sondern nur deren konkrete Ausdrucksform.

Dem wird zwar entgegengehalten, dass eine solche Fokussierung auf den Output die vorgelagerten Nutzungshandlungen ausblendet. Diese Kritik übersieht jedoch, dass die vorgelagerten Nutzungshandlungen sich genauso an das Urheberrecht halten müssen und separat beurteilt werden. Das eigentliche Problem dabei ist, dass in den hier relevanten Fällen der grossen ausländischen KI-Anbieter das Schweizer Recht auf diese vorgelagerten Werkverwendungen beim Training der KI womöglich gar nicht zur Anwendung kommt, wenn nicht in der Schweiz sondern beispielsweise in den USA trainiert wird.

Ausweitend kommt hinzu, dass die Regelung nicht nur für mit journalistischen Werken vermittelte Informationen gelten soll, sondern auch für Informationen aus beliebigem anderem Content, sofern dieser als "originäre Kreativleistung" angesehen wird. Dieser Begriff ist dem geltenden Urheberrechtsgesetz nicht bekannt, es ist allerdings anzunehmen, dass damit grundsätzlich alle urheberrechtlich geschützten Inhalte erfasst werden sollen, vermutlich selbst Bilder ohne individuellen Charakter, weil auch diese das Ergebnis eines schöpferischen Akts eines Menschen sein müssen. Die Klärung, ob darin selbst eine "Kreativleistung" gesehen werden kann, bliebe den Gerichten überlassen. Der Einleitungssatz der Motion stellt ebenfalls klar, dass alle vom Urheberrecht geschützten Werke und Leistungen erfasst sein sollen.

Einschränkend gilt, dass nur Fälle erfasst sein sollen, in denen ein Werk von einem GenKI-Service irgendwie "ausgelesen, verarbeitet und wieder angeboten" wird. Das "angeboten" könnte so verstanden werden, dass es sich um ein Werk handeln muss, über das der Benutzer noch nicht verfügt, weil sprachlogisch nur angeboten werden kann, worüber der Benutzer noch nicht verfügt. Ist ein GenKI-Dienst so ausgestaltet, dass er nur Inhalte umarbeitet, die ihm vom Benutzer zuvorher gefüttert wurden (z.B. ein Übersetzungsservice), wäre dies nicht erfasst. Das würde aus Sicht der Schweizer Medien genügen, denn ihr Problem ist es, ihre Inhalte überhaupt an den Mann oder die Frau zu bringen. Ob jemand einen Zeitungsartikel, den er schon hat, von der KI übersetzen lässt, kann ihnen egal sein.

Lässt der Benutzer jedoch einen GenKI-Dienst für sich im Internet nach passenden Inhalten zu einer Frage suchen, die der GenKI-Dienst diesem dann irgendwie zugänglich macht, dürfte Ziff. 1 greifen. Ob der Dienst ihm nur den Link anbietet oder eine Zusammenfassung, ist nach Ziff. 1 irrelevant, denn in beiden Fällen wird das ursprüngliche Werk auf der Website von GenKI ausgelesen und verarbeitet (denn anders "wüsste" der Dienst gar nicht, ob der Inhalt zur Suchanfrage des Benutzers passt) und dem Benutzer anschliessend angeboten. Dass es nicht das Werk selbst ist, das dem Benutzer übergeben wird, sondern nur ein Link oder eine Zusammenfassung, spielt hier gerade keine Rolle mehr, weil es für ersteres, wie erwähnt, keine Ziff. 1 bräuchte. Es genügt die Weitergabe blosser Information, auch ohne Wiedergabe des Werks. Ziff. 1 soll solche Handlungen also von der Zustimmung des Rechteinhabers abhängig machen. Das Problem Nr. 2 der Schweizer Medien wäre damit auf den ersten Blick tatsächlich zur Hälfte gelöst (für die andere Hälfte braucht es Ziff. 2, dazu unten). Eine andere Frage ist freilich, wie einem GenKI-Anbieter in der Praxis nachgewiesen werden kann, auf welchen Werken sein Output basiert, wenn diese darin im Wortlaut nicht mehr vorkommen und keine Quelle angegeben wird. Immerhin sind hier Tendenzen zu erhöhter Transparenz auch bei den grossen Anbietern erkennbar, weil der EU AI Act sie schlicht verlangt. Die meisten grossen KI-Entwickler haben zusätzlich den kürzlich publizierten "General Purpose AI Code of Practice" der EU unterzeichnet, der auch Transparenzregelungen enthält (siehe hier).

Darf ein KI-Modell noch Fragen zur Abwahl von Christoph Blocher beantworten?

Das Problem Nr. 1 – das Training eines Sprachmodells – wird durch die vorgeschlagene Regelung ebenfalls erfasst. Die beim Training verwendeten Inhalte werden nicht als solche im Modell gespeichert, sondern das Modell leitet daraus ein übergeordnetes Sprach- und Allgemeinwissen ab. Ein Text wird nur dann memoriert, wenn er sehr häufig vorkommt. Nur in diesem Fall kann er sich unter Umständen, insbesondere mit dem richtigen Prompt, im Output des Sprachmodells wiederfinden. Wie erwähnt, erfasst bereits das heutige Recht einen solchen Vorgang als Eingriff in das Ausschliesslichkeitsrecht des Rechteinhabers. Dafür wäre keine neue Regelung erforderlich.

Stattdessen geht die Motion Gössi deutlich weiter. Ziff. 1 erfasst in einer breiten Lesart zunächst jedes Anbieten von grossen Sprachmodellen. Denn angesichts der Menge an Daten, die erforderlich sind, um ein Sprachmodell zu trainieren, gibt es wahrscheinlich keine grossen Sprachmodelle, welche ausschliesslich auf der Basis von eigenen Inhalten trainiert worden sind oder von Inhalten von Rechteinhabern, deren Zustimmung zum Training vorgängig proaktiv eingeholt worden ist. Es stellt sich die Frage, ob durch den Betrieb eines Sprachmodells (z.B. durch einen Service wie ChatGPT) die ursprünglichen Werke wieder "angeboten" werden. Das wäre nach einer engen Lesart nur dann der Fall, wenn die Werke als solche im Output auftauchen, aber dann bräuchte es – wie schon oben vermerkt – die Ziff. 1 nicht, weil das schon vom heutigen Recht erfasst wäre. Es muss also bereits weniger genügen, d.h. das Anbieten wäre auch dann erfasst, wenn keine Teile mit den individuellen Charakteristika des ursprünglichen Werks im Output auftauchen und die Entwickler der Sprachmodelle nicht vorgängig eine Einwilligung der Rechteinhabern eingeholt haben.

Machen wir ein konkretes Beispiel. Wer einem Sprachmodell die Frage stellt "Wie kam es zur Abwahl von Christoph Blocher?" erhält eine Antwort, die aller Wahrscheinlichkeit nach zu wesentlichen Teilen aus dem Wissen entsprechender Schweizer Medienberichte entstanden ist, die für das Training des Sprachmodells ausgelesen und verarbeitet worden sind. Gilt das Anbieten eines Sprachmodells – mindestens in Form eines Chatbot-Services oder einer KI-Schnittstelle für Computer (API) für die Erstellung anderer KI-Anwendungen – als Anbieten (auch) dieser Inhalte? Vermutlich ja, da die Leistung im Output besteht, der generiert wird. Diese würde im genannten Beispiel Informationen umfassen, die das Sprachmodell aus den nn Zeitungsberichten zur Abwahl von Christoph Blocher "gelernt" hat. Ob nn 1, 10 oder 100 ist, kann vernünftigerweise keine Rolle spielen. Es ist den anvisierten KI-Services gerade eigen, dass sie eine enorme Menge von Quellen auswerten und zu einem Ergebnis zusammenfassen (genau darum ist der individuelle Charakter eines bestimmten journalistischen Texts regelmässig nicht mehr im Output erkennbar und gerade darum greift das Urheberrecht nicht). Zudem führt ein einzelner Text im Training nicht zur Memorisierung des darin enthaltenen Wissens; ein spezifischer Text müsste etliche Male gesehen werden oder das Wissen in vielen Texten vorkommen, damit er bzw. es als solcher bzw. solches tatsächlich Eingang in ein Modell findet und im Output auftauchen kann (anders beim Problem Nr. 2, wo ein einzelner Text genügen kann). Dass solche Fälle von Ziff. 1 nicht erfasst sein sollen, d.h. Ziff. 1 nur "Exklusivwissen" einer einzigen Quelle schützen will, ist nicht erkennbar. Dass die Informationen über die Abwahl Christoph Blochers erst einmal blosse Fakten sind, die als solche keinen urheberrechtlichen Schutz geniessen, ist nach der Motion Gössi auch irrelevant. Hinzu kommt in unserem Beispiel, dass nach Ziff. 1 nicht nur journalistische Inhalte die Anwendung der Regel triggern, sondern jeder urheberrechtlich geschützte Inhalt.

Es stellt sich die Frage, ob Ziff. 1 weitere Einschränkungen vorsieht. Eine könnte darin liegen, dass eine relevante Handlung nur dann vorliegt, wenn ein GenKI Anbieter sowohl ausliest, verarbeitet und wieder anbietet; die drei Aktivitäten sind kumulativ formuliert. Ein Unternehmen könnte die Inhalte aus den Quellen auslesen und verarbeiten, ein anderes sie anbieten. Das erscheint jedoch wenig sinnvoll, da die Regelung sich so ohne Weiteres durch Arbeitsteilung unterlaufen liesse. Wer ein grosses Sprachmodell trainiert, verarbeitet dafür Inhalte und wird zwangsläufig auch zum Anbieter des Modells, sofern er es nicht nur für interne Zwecke nutzt. Immerhin könnte argumentiert werden, dass er in diesem Fall nur das Modell und nicht den Output anbietet, aber auch dies trifft in vielen Fällen in der Praxis nicht zu. Firmen wie OpenAI oder Google trainieren die Sprachmodelle, die sie anbieten, auch selbst; einzig Microsoft bietet bisher primär nur Modelle von Dritten an (jene von OpenAI).

Nur (aber immerhin) das Anbieten muss in der Schweiz erfolgen

Eine weitere Einschränkung könnte sein, dass alle Teilhandlungen (auslesen, verarbeiten, anbieten) in der Schweiz stattfinden müssen, damit das Schweizer Urheberrecht anwendbar ist. Allerdings verunmöglicht spätestens Ziff. 3 eine solche Lesart, die festlegt, dass das Schweizer Recht bereits dann anwendbar sein soll, wenn lediglich das Anbieten in der Schweiz stattfindet, wobei die Regelung nicht völlig klar formuliert ist. Heute greift das Schweizer Urheberrecht in aller Regel nicht, wenn das Training im Ausland stattfindet und Schweizer Inhalte aus dem Ausland gecrawlt werden (es findet in der Schweiz keine Vervielfältigung statt, da der Webserver den Inhalt selbst ins Ausland sendet). Das Training und das Anbieten des Modells sind dabei zwei unterschiedliche Handlungen, die separat beurteilt werden müssen. Darum sind die Chancen heute gering, dass ein Schweizer Gericht gegen ein Crawling öffentlicher Inhalte in der Schweiz und ein Training im Ausland auch Schweizer Recht anwenden wird. Soll der Schutz Schweizer Inhalte auch im Ausland verstärkt werden, müsste die Motion anders formuliert sein. Jetzt erfasst sie nur das Anbieten der (irgendwo) erzeugten KI-Produkte in der Schweiz, nicht aber im Ausland. Dies schadet der Schweiz insofern, als dass ein Anbieter sich vor der Regelung trotz Nutzung von Schweizer Inhalten retten kann, indem er einfach die Schweiz nicht mehr bedient, den Rest der Welt hingegen schon.

Zusammengefasst bedeutet dies: Mit Umsetzung dieser Motion wäre in Zukunft sowohl das Anbieten von grossen Sprachmodellen in der Schweiz nur noch dann rechtskonform, wenn vorgängig proaktiv die Zustimmung der Rechteinhaber sämtlicher urheberrechtlich geschützten Quellen eingeholt worden ist, und zwar anders als bisher selbst dann, wenn keine einzige dieser Quellen ganz oder teilweise im Output wiedergegeben wird, sondern nur das daraus gewonnene Allgemeinwissen – siehe das Beispiel zur Abwahl von Christoph Blocher. Dieser letzte Punkt ist es, der die Forderung so speziell macht und ein Kernkonzept des Urheberrechts auf den Kopf stellen würde. Vorbehältlich natürlich einer gesetzlichen Gegenmassnahme wie etwa eine kollektive Lizenz (dazu sogleich und unten), um die Wirkung zu neutralisieren.

Schritt 2: Die traditionellen Schranken des Urheberrechts wie das Zitatrecht oder der Eigengebrauch werden für GenKI-Anbieter abgeschafft

Schon seit je her gilt das Urheberrecht nicht unbeschränkt. Es will eine faire Balance zwischen den Verwertungsmöglichkeiten des Rechteinhabers einerseits und den Interessen der einzelnen Nutzer und der Gesellschaft andererseits schaffen. Dafür sieht das Urheberrecht sog. "Schranken", also Ausnahmen, vor. Das Zitatrecht ist ein solches Beispiel, oder der Eigengebrauch. Darum darf jeder privat ein urheberrechtlich geschütztes Kunstwerk ausdrucken und bei sich zuhause aufhängen, und darum dürfen Unternehmen in Betrieben auszugsweise intern Kopien von urheberrechtlich geschützten Werken machen, z.B. wenn sie eine Seite aus dem Internet ausdrucken, damit sie sie auf Papier haben. Es gibt dafür auch eine Abgeltung, die allerdings kollektiv über die sogenannten Verwertungsgesellschaften abgewickelt wird. Das System funktioniert gut.

Diesen Grundpfeiler des Urheberrechts will die Motion für die durch Ziff. 1 erfassten Fälle ebenfalls abschaffen, vermutlich weil (verständlicherweise) befürchtet wird, dass sich die Anbieter, die für Problem Nr. 1 und Problem Nr. 2 verantwortlich sind, darauf berufen und damit das erweiterte Zustimmungserfordernis umgehen würden.

Es ist auf den ersten Blick nicht ganz klar, wie weit die Aufhebung dieser sog. Schrankenbestimmungen für KI-Anbieter geht. Während sich der erste Teilsatz eindeutig "nur" auf einzelne Schrankenbestimmungen bezieht und diese explizit aufführt, ist der zweite Teilsatz von Ziff. 2 sehr absolut formuliert – es müsste also beispielsweise auch das Zitatrecht, das Parodierrecht oder der Eigengebrauch für GenKI-Anbieter abgeschafft werden.

Der erste Satz nennt "nur" Schrankenbestimmungen, die beim Training von Sprachmodellen und in der Wissenschaft zum Einsatz kommen (Art. 24d), beim Surfen im Internet (Art. 24a), bei der Medienberichterstattung (Art. 28) und beim Eigengebrauch ausserhalb des privaten Bereichs (Art. 19 Abs. 3). Dieser letzte Artikel ist allerdings gar keine Schrankenbestimmung, sondern das Gegenteil, nämlich eine Ausnahme von den Schrankenbestimmungen. Dies und auch die weiteren Formulierungen ("ggf.", "nicht auf Ausnahmen oder Schranken" statt "nicht auf diese Ausnahmen oder Schranken") legen nahe, dass die Motion im Grunde jede Schrankenbestimmung im Rahmen von KI-Dienstleistungen aufheben will. Klarer sind die Erläuterungen der Motion: Der Eigengebrauch, die Forschungsausnahme und die Ausnahme für flüchtige oder begleitende Vervielfältigungen werden ausdrücklich ("insbesondere") nur als Beispiele genannt. Doch auch wenn es nur um diese drei Beispiele ginge, würde Ziff. 2 sehr weit gehen.

Im vorliegenden Fall ist ferner nicht klar, ob die Aufhebung der Schrankenbestimmungen nur für Anbieter generativer KI gelten soll, die nach Ziff. 1 die urheberrechtlich geschützten Werke verarbeiten, oder für Anbieter von KI ganz generell, da Ziff. 2 jedenfalls nach dem Wortlaut keine Unterscheidung macht bzw. im Verweis nicht klar ist. Konzeptionell zielt sie allerdings klarerweise auf generative KI, da das, was der inkriminierte KI-Dienst anbietet, auch wieder ein Inhalt sein muss. Wird ein KI-Modell anhand von urheberrechtlich relevanten Inhalten z.B. darauf trainiert, Gegenstände oder Stimmungen anhand eines Bildes zu erkennen, wird dieses Bild nicht angeboten, auch nicht indirekt. Dies ist deshalb relevant, weil auch andere KI-Anwendungen mit urheberrechtlich geschützten Inhalten trainiert sein können.

Die Folge: Manche KI-Angebote in der Schweiz würden faktisch verboten

Die vorgeschlagene Kombination von Ziff. 1, 2 und 3 dürfte, wird sie im Schweizer Urheberrecht tatsächlich wie oben beschrieben umgesetzt, gewichtige Folgen für das Anbieten von Dienstleistungen generativer und teils auch anderer KI in der Schweiz haben. Ein Vertreter der Tech-Branche sprach gar von der weltweit striktesten urheberrechtlichen Regelung im Zusammenhang mit generativer KI. Wird ihre Wirkung nicht durch einen "Gegenkniff" neutralisiert bzw. unterlaufen (siehe dazu unten), muss damit gerechnet werden, dass viele Angebote, die heute weit verbreitet sind, in der Schweiz nicht mehr rechtskonform angeboten werden und damit im Ergebnis faktisch verboten sind.

Allerdings muss auch hier differenziert werden, was eine Umsetzung wie von der Motion verlangt und ohne Gegenmassnahmen bedeuten würde:

- Sprachmodelle: Anbieter von grossen Sprachmodellen und anderen KI-Modellen (z.B. für Bilder), die auf Basis urheberrechtlich relevanter Inhalte trainiert wurden, könnten ihre Angebote für die Schweiz einstellen. Denn damit Ziff. 1 greift, reicht es, dass das Modell mit solchen Quellen trainiert worden ist. Ob im Output eines solchen Modells urheberrechtlich geschützte Trainingsquellen erkennbar wiedergegeben werden, würde anders als heute wie gesagt keine Rolle mehr spielen. Da das proaktive Einholen einer Zustimmung aller Rechteinhaber praktischerweise nicht möglich ist, aber zugleich die Schrankenbestimmungen, auf die die Anbieter sich bisher stützen konnten, aufgehoben wären, drohen solche Angebote nicht mehr urheberrechtskonform zu sein. Die Schrankenbestimmungen gibt es genau aus diesem Grund: Der Gesetzgeber war sich bewusst, dass das Einholen der Zustimmung sämtlicher Rechteinhaber oft nicht oder nur schwer möglich ist. Er erlaubte daher diverse Nutzungen, sah dafür aber teilweise eine Gebührenpflicht zugunsten der Rechteinhaber vor, die sog. (normale) Kollektivverwertung. Wird der Eigengebrauch allerdings aufgehoben, entfällt damit auch die in Art. 20 URG zum Ausgleich an sich bereits vorgesehene Abgabe. Es müsste auf andere Mechanismen wie die erweiterte Kollektivlizenz zurückgegriffen werden, die aber ihre eigenen Herausforderungen hat (siehe unten). Warum sich ein KI-Anbieter in einer solchen Situation auf das Risiko eines rechtswidrigen und möglicherweise strafbaren Angebots seiner Dienstleistung in der Schweiz noch einlassen sollte, ist nicht ersichtlich. Er könnte zwar in den Vertragsbedingungen festhalten, dass die Benutzer für die Beschaffung aller Rechte der Nutzung sorgen und die Anbieter bei Ansprüchen Dritter freistellen müssten. Das hilft aber höchstens zivilrechtlich, und es ist auch sonst fraglich, ob es funktioniert. Das Problem beginnt ja bereits beim Training. Die Benutzer müssten zusichern, die Sprachmodelle nicht für die Generierung neuer Inhalte zu nutzen, was sie für die meisten Anwendungen wertlos macht; inzwischen haben unzählige Betriebe eigene Anwendungen mit grossen Sprachmodellen realisiert. Chatbots sind nur ein Beispiel.

- KI-Dienste, die Drittinhalte vermitteln: Das Anbieten von Chatdiensten wie ChatGPT oder Copilot für die Schweiz würde gleichermassen eingeschränkt, und zwar einerseits wegen des Outputs, den die dafür verwendeten Sprachmodelle aus dem eigenen "Wissen" generieren können, andererseits aber auch wegen Zusatzfunktionen, die eine Internet-Suche oder das Recherchieren im Internet erlauben. Einige Dienste sind darauf sogar spezialisiert, wie der eingangs und in der Motion zitierte Dienst "Perplexity" (aber auch ChatGPT, Google Gemini oder Microsoft Copilot gehören dazu). Solche KI-Dienste mit und ohne Internet-Suche werden privat und geschäftlich intensiv genutzt. Kommt es zum Internet-Zugriff werden immer auch urheberrechtlich relevante Inhalte aus dem Internet verwendet, für welche nie sichergestellt werden kann, dass eine Zustimmung des Rechteinhabers vorliegt. Zwar gibt es heute mit den erwähnten "Opt-out"-Signalen die Möglichkeit, dass Programmierer von Websites den Bots von Suchdienst- und KI-Firmen anzeigen können, ob sie die Website nach Inhalten absuchen oder aussen vor bleiben sollen, aber dies wird nicht flächendeckend eingesetzt und löst das Problem (wie weiter unten dargelegt) nicht. Ziff. 1 verlangt nicht das Fehlen eines Opt-outs (wie es im Ausland das Gesetz teilweise vorsieht oder diskutiert wird), sondern das Vorliegen einer Zustimmung. Diese muss vom Rechteinhaber kommen, nicht dem Betreiber der Website.

- KI-Dienste, die keine Drittinhalte vermitteln: Weniger klar ist die Situation bei KI-basierten Tools, die "nur" Inhalte ihrer Nutzer verarbeiten, wie etwa Übersetzungs-Dienste wie DeepL. Auch hier werden urheberrechtlich geschützte Inhalte ausgelesen, verarbeitet und dem Benutzer zurückgegeben. Es liefert und entscheidet aber der Benutzer. In einem Entscheid zu einem Dokumentenlieferdienst der ETH Zürich aus dem Jahre 2014 befand das Bundesgericht, dass deren Handlungen (Kopien aus wissenschaftlichen Journals auf Bestellung) rechtlich als Handlungen der Auftraggeber gelten (BGE 140 III 616, E. 3.4.3), weshalb die anschliessende Zusendung der Kopie an den Besteller keine eigenständige Urheberrechtsverletzung darstellen konnte bzw. für die Frage der Verletzung darauf geschaut wird, ob der Auftraggeber die nötigen Rechte hat oder sich auf Schrankenbestimmungen berufen kann. Im selben Entscheid stellte das Gericht allerdings auch klar, dass für Nutzer, die Dritte (wie Bibliotheken oder kommerzielle Dienste) für die Vervielfältigung beiziehen, strengere Regeln gelten als bei der Anfertigung einer Kopie im rein privaten Kreis (E. 3.5.2). Es ist also nicht völlig klar, ob Ziff. 1 und Ziff. 2 auch bei GenKI-Diensten greifen würde, wo alle Inhalte vom Benutzer kommen und diese lediglich umgeformt werden, wie bei reinen Übersetzungen oder Textkorrekturen. Wir gehen derzeit nicht davon aus, dass Ziff. 1 und Ziff. 2 in diesen Fällen greift, weil sie nur Handlungen erfassen will, die dem Anbieter zugerechnet werden und nur er soll sich nicht mehr auf die Schrankenbestimmungen berufen können. Hingegen dürfte wie oben dargelegt Ziff. 1 dort greifen, wo der KI-Dienst zwar für einen Benutzer im Internet suchen geht, er dies aber selbständig tut ("Erstelle mir eine Zusammenfassung zu den Schweizer Reaktionen auf die Zölle von Donald Trump"). Auch hier liesse sich vertreten, dass diese Handlung dem Benutzer zugerechnet werden müsste und somit weder Ziff. 1 noch Ziff. 2 greift, weil der KI-Dienst wie der lange Arm des Benutzers behandelt würde und daher an ihn adressierte Urheberrechtsbestimmungen keine Anwendung finden (d.h. solche Angebote wären weiterhin ohne Zustimmung der Rechteinhaber erlaubt). Eine solche Auslegung würde jedoch das Kernanliegen der Motion ("umfassend Schutz") untergraben und würde daher wohl eher nicht geschützt. Gegen sie spricht auch, dass in diesen Fällen es nicht der Benutzer, sondern die KI ist, die festlegt, welche Inhalte bei einer solchen Auftragssuche zusammengetragen werden.

- Suchdienste: Internet-Suchdienste wie jene von Google setzen inzwischen stark auf KI. Schon seit Jahren werden alle Suchanfragen durch KI ausgewertet. Dies dürfte von Ziff. 1 allerdings nicht erfasst sein. Erfasst sein würden von einer solchen neuen Regelung aber die mittels KI generierten Kurzzusammenfassungen oder Trefferauszüge (Snippets) von gefundenen Websites. Sie wären wohl faktisch in der Schweiz aus den für KI-Dienste erwähnten Gründen nicht mehr zulässig.

- Forschung: Betroffen wäre auch die Schweizer KI-Forschung. So kündigten die ETH Zürich und EPFL Lausanne kürzlich das erste grosse Schweizer Sprachmodell an (siehe hier) und ernteten damit weltweit Lorbeeren. Kommentatoren sehen darin einen wichtigen Schritt im Bereich der digitalen Souveränität der Schweiz. Für das Training, so hiess es, wurden nur Inhalte von Websites benutzt, die das nicht mittels maschinenlesbarem Opt-out untersagt hatten. Solche Initiativen drohen bei einer Umsetzung der Motion, wie von Ziff. 1-3 verlangt unmöglich zu werden. Dem lässt sich allenfalls noch entgegenhalten, dass die Begründung der Motion an einer Stelle nur von "kommerziellen" Anbietern spricht und darum würde es sich im Beispiel der ETH und EPFL nicht handeln. Die negativen Auswirkungen auf den KI-Forschungsstandort Schweiz wären wohl trotzdem erheblich, da die Forschung wohl auch auf die Verfügbarkeit von Diensten kommerzieller KI-Anbieter angewiesen ist. Es erstaunt daher nicht, dass Schweizer KI-Forscher die Motion als gefährlich beurteilen und sie nicht unterstützen.

Ein Eigentor für die Schweiz – und die Schweizer Medien?

Kritiker befürchten, dass die geforderte Regelung den Zugang der Schweiz zu GenKI-Diensten erheblich einschränken wird, und dass sich die Schweiz damit vor allem selbst schadet. Sie sehen auch die Schweizer Medienhäuser von einer solchen Entwicklung massiv betroffen – und dies wohl stärker als die KI-Anbieter, gegen die sie sich schützen wollen. Beispiele sind diverse denkbar: Journalisten, die für ihre Recherchen heute KI-gestützte Such- und Analysetools nutzen, könnten diese nicht mehr oder nur noch eingeschränkt nutzen; sie bräuchten für dieselbe Arbeit mehr Zeit und wären weniger konkurrenzfähig, gerade gegenüber ausländischen Medienhäusern. Verlage drohen für ihre selbstentwickelten KI-Anwendungen den Zugang zu Sprachmodellen und damit die technische Basis zu verlieren, weil Anbieter die Vorgaben von Ziff. 1 nicht oder nicht sicher erfüllen können werden. Selbst wenn Verlage nur eigene Inhalte mit eigenen Modellen verarbeiten würden, wären sie nicht auf der sicheren Seite: So enthalten Medienbeiträge ihrerseits oft Zitate oder Material aus anderen Quellen, die sie nur dank der heute geltenden urheberrechtlichen Schranken als Teil ihrer Leistung anbieten dürfen – auch mittels KI. Als Anbieter von Leistungen mit GenKI-Komponenten dürften sie sich aber nicht mehr auf diese Schranken berufen, wenn die Motion so umgesetzt wird, dass der von ihr verlangte "umfassende" Schutz aufgebaut wird.

Die Vertreter der Schweizer Medien sehen keine solchen Folgen. Sie betonen, dass es ihnen einzig um eine faire Vergütung gehe. Diese können mittels Lizenzen gelöst werden. Die verlangte gesetzliche Regelung ist nach ihrer Ansicht viel weniger streng, als der Wortlaut der Motion nahelegt. Eingeschränkt würden nur wenige Schrankenbestimmungen. Auch sei mit "Zustimmung" gemäss Ziff. 1 faktisch nur ein Widerspruchsrecht gemeint. Das erscheint allerdings nicht wirklich überzeugend. "Tue nicht" ist nicht dasselbe wie "Ja, Du darfst". Zwar gibt es das Konzept der konkludenten Zustimmung bei Aufschalten von Inhalten im Internet im Wissen um KI-Bots, doch bietet es erhebliche Untiefen und gilt wie oben gezeigt nicht als verlässliche Grundlage. Sie verlassen sich offenbar darauf, dass die Motion nicht so absolut umgesetzt wird, wie sie daherkommt.

Die Motion selbst ist jedoch sehr deutlich: Es geht um eine konsequente und wirksame Lösung der genannten Probleme der Schweizer Medien, und eine solche stellt sie durchaus dar. Der Haken an ihr ist, dass ein enormer Kollateralschaden damit in Kauf genommen wird, der sich auch mit Konzepten wie der konkludenten Zustimmung oder einzelnen Lizenzdeals mit Medien nicht verhindern lässt. Rechtlich ist es im Übrigen unbeachtlich, wie die Motionärin ihre Motion angesichts der aufkommenden Kritik heute verstanden haben möchte. Sie kann die Motion auch nicht mehr zurückziehen. Natürlich könnte die Motion Gössi vom Bundesrat schlicht nicht befolgt werden; das Parlament müsste sich gegen eine zu weiche Umsetzung wehren. Oder zum Beispiel könnte sie mit einer neuen Form der erweiterten Kollektivlizenz "neutralisiert" werden (dazu unten). Es fragt sich aber, ob es wirklich sinnvoll ist, das Urheberrecht um sich gegenseitig aushebelnde Bestimmungen zu ergänzen statt direkt zum Beispiel eine klare Rechtsgrundlage für KI-Nutzungen mit dem nötigen Opt-out zu schaffen und so allen Bedürfnissen gerecht zu werden – Rechtssicherheit und Schutz.

Und es bleibt noch ein anderes Problem, das nicht zu Ende gedacht scheint: Wenn es tatsächlich primär um jene KI-Firmen geht, die sich nicht um Bezahlschranken scheren, und es bisher zwar nicht an der rechtlichen Handhabe, aber an deren Durchsetzbarkeit mangelte, dann ist fraglich, was eine neue rechtliche Handhabe tatsächlich bringt, wenn die Hürden für die Beschreitung des Rechtswegs für die Rechteinhaber offenbar schon bisher regelmässig zu hoch waren. Daran würde auch ein angepasstes Urheberrecht vermutlich nichts ändern.

Darüber hinaus geht es um Wettbewerb im Rahmen des geltenden Rechts. Es gibt weder Schlupflöcher noch Gesetzeslücken, nur - aber immerhin - veränderte wirtschaftliche Realitäten. Selbstverständlich darf sich der Gesetzgeber überlegen, durch regulierende Eingriffe bestimmte Branchen vor solchen Veränderungen zu schützen und Gesetze für Wettbewerbspolitik einzusetzen. Ehrlicherweise sollte dies jedoch auch so bezeichnet werden.

Auch wäre zu berücksichtigen, dass sich technologischer Wandel erfahrungsgemäss nicht durch Regulierung aufhalten lässt (siehe etwa den erläuternden Bericht zur Vernehmlassung im Bereich des Leistungsschutzrechts, hier). Es entsteht aber der Eindruck, dass es im Kern gerade darum geht. Schliesslich ist zu beachten, dass der Gesetzgeber gemäss Verfassung nicht uneingeschränkt frei ist, in den Wettbewerb einzugreifen, d.h. gewisse Marktteilnehmer vor anderen zu schützen. Nach Art. 96 Abs. 4 BV sind Abweichungen vom Grundsatz der Wirtschaftsfreiheit, insbesondere auch Massnahmen, die sich gegen den Wettbewerb richten, hier nur zulässig, wenn sie in der Bundesverfassung vorgesehen sind.

Am Rande sei vermerkt, dass die Motion die KI-Anbieter nur beim Anbieten in der Schweiz einschränkt, nicht beim Nutzen von Schweizer Inhalten ganz generell. Die Motion untersagt Entwicklern nicht, Inhalte aus der Schweiz abzurufen und für das Training ihrer Modelle oder die Inhalte ihrer KI-Dienste zu nutzen – solange sie diese nicht in der Schweiz anbieten. Die Schweiz würde sich mit einer unbedachten Gesetzesanpassung somit vor allem selbst schaden.

Beispiel für nicht zu Ende gedachtes Regulieren neuer Technologien

Die Motion Gössi erscheint nach dem Gesagten als Beispiel dafür, wie nicht zu Ende gedachtes Regulieren von neuen technischen Entwicklungen für ein berechtigtes Anliegen zum Eigentor werden kann, oder jedenfalls unnötige Unsicherheit und Aufwand generiert. Das gilt vor allem, wenn ohne vertiefte Kenntnis der rechtlichen, technischen und sonstigen Zusammenhänge vorgegangen wird, wie dies im Bereich KI leider häufig vorkommt. Dass die Politik über Regulierung von KI besonders intensiv nachdenkt und sich fragt, was hier gemacht werden muss, ist freilich verständlich und richtig. Dies umso mehr, als dass das Thema viele Menschen bewegt – und bei dem sich auch viele Berufskreise bedroht fühlen. Wenn dabei viele gleichzeitig am Ast sägen, auf dem sie selbst sitzen, ist das aber suboptimal. So ist der Einsatz von KI gerade in der Medien- und Kreativbranche nicht mehr wegzudenken – auch mit ihren positiven Seiten. Das Wechselbad der Gefühle, das bei disruptiven neuen Technologien in den ersten Jahren der Wahrnehmung immer existiert, weicht erfahrungsgemäss über Zeit einer gewissen Gewöhnung bzw. Ernüchterung. Der aufgewirbelte Staub setzt sich und wir betrachten die negativen wie auch die positiven Seiten etwas gelassener. Das sollte der Gesetzgeber beim Regulieren beachten, und gerade in der Schweiz haben wir damit gute Erfahrungen gemacht.

Was in der vorliegenden Angelegenheit darum etwas erstaunt, ist die Tatsache, dass der Bundesrat die Annahme der Motion kommentarlos empfohlen hat. Vielleicht nahm die Anzahl an Vorstössen überhand, und so sah er sich genötigt, für einmal einem Vorstoss nachzugeben, um nicht als Verhinderer zu erscheinen. Vielleicht ging er aufgrund der Begründung davon aus, er stärke damit die Innovationskraft der Schweiz, ohne zu hinterfragen, was die Regelung wirklich tut. Was auch immer die Hintergründe sind, klar scheint jedenfalls, dass diese Position des Bundesrats kaum mit dem Ergebnis seiner KI-Regulierung-Auslegeordnung in Einklang zu bringen ist, in welcher der Bundesrat einen Rechtsrahmen skizziert, der in erster Linie die Innovationskraft der Schweiz stärken möchte. Noch im Frühjahr entstand seitens des Bundesrats der Eindruck, dass er nicht wirklich Anpassungsbedarf in diesem Bereich sieht (siehe hier) und er sich generell mit Regulierungsvorschlägen Zeit lassen will bis Ende 2026. Jetzt befürchten gewisse Kreise, dass die Motion im Falle einer Annahme im "Fast Track" im Zuge einer bereits angedachten Revision des Urheberrechts umgesetzt werden könnte. Da wird das Thema eines Leistungsschutzrechts bekanntlich bereits diskutiert, was in dieselbe Richtung geht. Das Risiko eines solchen "Fast Tracks" ist, dass nicht genügend Zeit für das Verstehen und die Diskussion der Problematik und ihrer Lösung und die in der Schweiz übliche Harmonisierung mit dem EU-Recht bleibt.

Der Widerstand erwacht – der politische Prozess

Der Ständerat hat der Motion Gössi von der Öffentlichkeit und Fachwelt weitgehend unbemerkt und ohne grosse Diskussion bereits zugestimmt. Am 14. bzw. 15. August 2025 soll sie in der vorberatenden Kommission des Nationalrats behandelt werden. Anfang September 2025 folgt die Abstimmung im Plenum.

Wird eine Motion mit konkreten Gesetzesformulierungen von beiden Kammern des Schweizer Parlaments angenommen, ist der Bundesrat grundsätzlich an den darin enthaltenen Auftrag gebunden. Dieser Auftrag verpflichtet die Regierung nach Art. 120 Abs. 1 Parlamentsgesetz, eine Gesetzesvorlage auszuarbeiten, die den Forderungen der Motion entspricht. Dieser Prozess beinhaltet in der Regel die Erarbeitung eines Vorentwurfs durch die Bundesverwaltung, ein Vernehmlassungsverfahren, bei dem Kantone, Parteien und Verbände Stellung nehmen können, und schliesslich die Beratung und Beschlussfassung im Parlament. Der Spielraum des Bundesrates bei der Umsetzung einer solchen Motion ist in der Praxis vorhanden, jedoch durch den detaillierten Text der Motion eingeschränkt. Der Bundesrat darf den Kerninhalt der Motion nicht unterlaufen. Wesentliche Elemente der Motion darf er nicht einfach weglassen oder gegen das Hauptanliegen verstossen.

Selbst bei einer Annahme und Überweisung der Motion an den Bundesrat ist somit noch nichts endgültig beschlossen. Hitzige Diskussionen sind schon vorher zu erwarten. Inzwischen haben nämlich diverse Stakeholder gemerkt, welche Sprengkraft die Motion birgt und haben damit begonnen, sie zu bekämpfen. Die Gräben sind tief, und sie gehen mitten durch die Schweizer Wirtschaft: Grosse Teile wollen hier keine Einschränkungen, weil sie darin eine Bedrohung für den Standort Schweiz und die hiesige Innovation sehen, andere sehen ihr Geschäft ganz grundsätzlich in Gefahr, wenn der Gesetzgeber nicht für eine Entschädigung sorgt.

Nötig wäre die Motion übrigens nicht. Der Bundesrat ist, wie erwähnt im Zusammenhang mit dem Leistungsschutzrecht sowieso daran, eine Anpassung des Urheberrechts vorzubereiten (siehe hier) und könnte dem Parlament ohne Weiteres auch aus eigenem Antrieb Vorschläge zu einer vorübergehenden Adressierung zur Thematik unterbreiten, um hier etwas Druck abzubauen und eine Diskussion zu ermöglichen – was er gemäss gut informierten Kreisen vermutlich auch tun will. Die von der Motion verlangten Regelungen passen dem Vernehmen nach nicht dazu. Die Gedanken gehen auch in der Fachwelt in eine andere Richtung (siehe unten). Die Motion Gössi polarisiert die Debatte nur, was nicht förderlich erscheint.

Bedacht werden sollte zudem das Signal, welches die Schweiz international aussenden würde, wenn ihr Parlament die Motion trotzdem überweisen würde. Kritiker befürchten, die Schweiz würde sich als Forschungs- und Wirtschaftsstandort selbst disqualifizieren, wenn sie der Welt zu verstehen gibt, dass sie den Einsatz von KI hierzulande gesetzlich massiv einschränken will.

Es darf also gespannt verfolgt werden, ob der Nationalrat hier mit mehr Verständnis der Sache und Weitblick das Dossier behandeln wird.

Wie es besser ginge – die Vorschläge der Fachwelt

Selbst wenn die Motion es nicht durch den Nationalrat schaffen sollte, stellt sich die Frage wie die beiden eingangs skizzierten Probleme Nr. 1 und 2 gelöst werden sollen. Dass ein diesbezüglich wirtschaftspolitischer Wille besteht, darauf deutet die erste Annahme der Motion Gössi klar hin, und das scheint auch sinnvoll. Wie weit die Sympathien für die Rechteinhaber gehen, wenn die Folgen für die Nutzer und Konsumenten von KI diskutiert werden, ist nicht ganz klar. Während in den USA Einschränkungen vor allem abgebaut werden sollen (so sollen nach der Trump-Administration an sich geschützte Inhalte für KI-Trainings kostenlos genutzt werden können, siehe etwa hier), ist die gefühlte Lage in Europa nicht derartig eindimensional. Traditionell werden Rechteinhaber in Europa gut unterstützt. Allerdings findet das Argument, es gelte die Schweiz als Standort für KI-Innovation zu schützen und zu stärken, ebenfalls Anklang – diesbezüglich wird die Motion Gössi in Kreisen derjenigen, die tatsächlich Innovation betreiben, als klar schädlich empfunden.

Die hiesigen Regulierungsansätze der Fachleute gehen jedenfalls in eine andere Richtung in der Frage, wie Rechteinhaber besser geschützt werden können. Eine kürzlich publizierte Studie im Auftrag des Europaparlaments schlägt zum Beispiel auch im EU-Recht konkrete Regelungen vor, um Rechteinhaber besser zu schützen, wenn ihre Inhalte für generative KI und Modelltrainings verwendet werden und diese insbesondere auch zu vergüten (siehe hier). Sie betont die Notwendigkeit klarer Unterscheidungen zwischen Input und Output, harmonisierter Opt-out-Mechanismen, Transparenzpflichten und fairer Lizenzmodelle. Ein zentraler Vorschlag ist die Einführung eines Vergütungssystems für Urheber, deren Werke für das KI-Training verwendet werden. Dies könnte in der Schweiz bspw. durch kollektive Lizenzierung oder eine Abgabe auf KI-generierte Inhalte erfolgen, die von Verwertungsgesellschaften verwaltet wird. Zusätzlich werden Transparenzpflichten für KI-Entwickler gefordert, um die Nutzung urheberrechtlich geschützter Inhalte offenzulegen. Die Studie empfiehlt dem Europäischen Parlament, Reformen anzuführen, die die sich wandelnden Realitäten von kreativer Arbeit, Kunstschaffen, Urheberschaft und maschinengenerierten Inhalten berücksichtigen und ein Gleichgewicht zwischen Innovation und Urheberrechten herstellen.

In der Schweiz publizierte kürzlich der Zürcher Professor Florent Thouvenin ein Whitepaper, welches zur besseren Abgeltung und zum Schutz von Rechteinhabern, deren Werke für das Training generativer KI verwendet werden, die Einführung einer neuen Schranke im Urheberrechtsgesetz vorschlug (siehe hier). Diese Schranke soll die Nutzung von urheberrechtlich geschützten Werken für KI-Training grundsätzlich erlauben, aber ein Opt-out-Recht für Rechteinhaber vorsehen. Dieses Opt-out soll maschinenlesbar sein, um eine effiziente Umsetzung zu gewährleisten. Zusätzlich wird die Kombination dieser Schranke mit einer gesetzlichen Lizenz diskutiert, die eine Vergütungspflicht für die Nutzung der Werke vorsieht, wobei Rechteinhaber durch Opt-out die Nutzung ihrer Werke generell verbieten und anschliessend Lizenzen an einzelne KI-Anbieter vergeben könnten.

Soll sich die Schweiz an die EU angleichen – mindestens in einem ersten Schritt?

Der Vorschlag der Freistellung mit Opt-out geht in die Richtung dessen, was in der Europäischen Union im Urheberrecht heute schon gilt: Die dortige Regelung ist ähnlich der Schweizer Forschungsausnahme (die Rede ist in der EU von der sog. Text and Data Mining-Ausnahme, kurz TDM). Sie sieht aber im kommerziellen Bereich ein Opt-out vor, was das Schweizer Pendant nicht tut. Die TDM-Ausnahme wird häufig als Rechtsgrundlage für das Training von KI-Modellen zitiert. Der EU AI Act greift diese Regelung auch auf und verlangt von Anbietern zu zeigen, wie sie sie einhalten. Die Erweiterung der Schweizer Forschungsausnahme um ein solches Opt-out könnte also eine vorübergehende Lösung sein, die der Diskussion um eine sachgerechte Lösung Zeit verschaffen würde. Allerdings würde die Schweiz als Standort für Unternehmen, die selbst Modelle trainieren wollen, an Attraktivität verlieren.

Die Regelung löst allerdings nur das Problem Nr. 1, nicht das gewichtigere Problem Nr. 2. Die Lösung dieses zweiten Problems durch einen Eingriff in das Urheberrecht ist aber wesentlich heikler, da es letztlich um die Monopolisierung von Informationen, nicht eines konkreten Werks geht, denn letzteres ist bereits unter geltendem Recht geschützt. Wissen soll aber nach unserem bisherigen Werte- und Rechtsverständnis frei sein und frei gewonnen und weitergegeben werden dürfen, jedenfalls wenn ein rechtmässiger Zugang zum Werk besteht, wie das bei publizierten Artikeln regelmässig der Fall ist. Es soll mit anderen Worten jeder weitererzählen können, was er in der Zeitung gelesen hat, und wenn er dazu eine Lesehilfe einsetzt, ist das an sich nicht anders, selbst wenn diese mit KI arbeitet. Es kam bisher jedenfalls auch (zu Recht) niemand auf die Idee einer sehbehinderten Person zu verbieten, sich Seiten im Internet suchen, zusammenfassen und vorlesen zu lassen, weil sie das selbst nicht kann. Darum gibt es dafür in Art. 24c des Urheberrechtsgesetzes sogar eine der erwähnten Schrankenbestimmungen.

Das Problem Nr. 2 ist daher nicht im Prinzip begründet, sondern in der Masse. Unklar ist, ob der Umstand, dass es einige wenige Unternehmen sind, die die "Aufmerksamkeit" der Benutzer für sich abschöpfen, ebenfalls zum Problem gehört. Würden alle Benutzer ein eigenes Abo bei ihrem Lieblingsmedium lösen, aber stattdessen einen KI-Agenten die Online-Zeitung lesen lassen, wäre das Problem nicht ganz verschwunden (die Werbung in der Zeitung wäre vergebens), aber die Abo-Entgelte wären da. Allerdings wird dem entgegengehalten, dass es gar nicht Bezahldienste sind, die hier leiden, sondern die Inhalte vor der Paywall, die mehrheitlich durch Werbung finanziert werden. Diese wären durch persönliche KI-Agenten genauso tangiert, weil bei ihnen die Wirkung der Werbung und damit eine wichtige Einnahmequelle ebenfalls verpufft.

Auch sehr praktische, technische Fragen ist bei solchen Konzepten noch nicht gelöst: Wenn ein Opt-out-Recht gesetzlich eingeführt wird, wie soll es ausgeübt werden müssen? Wie schon gezeigt, genügt ein Opt-out durch den Website-Betreiber mittels Standards wie Robots.txt in der Regel nicht, wenn er nicht der Rechteinhaber ist, denn dieses Recht würde nur ihm zustehen. Dass das Opt-out maschinenlesbar sein müsste, erscheint aus praktikablen Überlegungen zwingend, ist aber keineswegs gesetzt; dort, wo es das im EU-Recht schon gibt, ist zum Beispiel nicht klar, ob das so sein muss, oder ob zum Beispiel ein öffentliches Statement irgendwo in den Medien oder in der Öffentlichkeit genügt (siehe Beispiel Sony hier). Für die KI-Anbieter wäre es unmöglich, immer zu wissen, wer ein solches ausgesprochen hat und wann sie es mit einem Inhalt zu tun haben, der davon betroffen ist, etwa wenn sie einen solchen auf der Website eines Dritten finden. Also müsste das Opt-out konsequenterweise doch mit der Website verknüpft werden. Dann aber müsste erst ein entsprechender technischer Standard geschaffen werden, der dann wiederum international oder mindestens in Europa gilt, den ein Alleingang der Schweiz scheint hier nicht wirklich eine Option. Mit anderen Worten: Auch wenn ein Opt-out eine kompromissfähige Lösung zu sein scheint, müssten auch hier noch Abstimmungs- und Entwicklungsarbeiten geleistet werden.

Abgeltung auf dem Weg einer Kollektivverwertung als Kompromiss?

Ein möglicher Ansatz könnte eine Erweiterung eines bereits bestehenden Modells im Bereich der Kollektivverwertung sein, welche eine Abgeltung für die digitalen Kopien vorsieht, die von KI-Agenten vorgenommen werden. In der bisherigen Welt gibt es den "Kopierrappen", eine Abgeltung, die für jede betriebsinterne Kopie eines Werks erhoben wird und damit die Rechteinhaber wie oben bereits erwähnt für die wirtschaftliche Nutzung ihrer Werke im Rahmen der Schrankenbestimmungen (i.c. betrieblicher Eigengebrauch) abgegolten werden. Sie wird rein statistisch berechnet und fällt erst ab einer Bagatellschranke und im gewerblichen Bereich an.

Entscheidend wäre die Ausgestaltung des Tarifs, der nach wirtschaftlicher Ausbeute abgestuft sein könnte, und die Verteilung der Einnahmen. Der Charme einer solchen Lösung wäre, dass nicht an den Grundprinzipien des Urheberrechts manipuliert werden müsste – mit entsprechenden "unintended consequences". Es könnte stattdessen durch eine geschickte Ausgestaltung des Tarifs den Rechteinhabern ein fairer Anteil am ökonomischen Gewinn der KI-Dienstanbieter zugewiesen werden. Es gibt bereits diverso solche Tarife, das System ist eingeführt und funktioniert im Grunde auch. Es ist nicht einmal klar, ob eine gesetzliche Anpassung nötig wäre.

Die Lösung hat allerdings diverse Haken. Einer ist, dass sie den KI-Anbietern nur beschränkte Rechtssicherheit gibt; sie dürften verlangen, dass dann auch klargestellt wird, dass sie die Inhalte, um die es geht, für ihre Zwecke nutzen dürfen. Ein weiterer Haken an dieser Lösung ist, dass es nicht mehr die Rechteinhaber sind, die einzelfallweise über Lizenzverträge über ihre Einnahmen verhandeln könnten. Stattdessen würde der Tarif übergreifend festgelegt, und dieser dürfte angesichts des verschwindend kleinen Beitrags einzelner Inhalte minim sein. Hinzu kommt, dass sich noch zeigen muss, was die grossen Anbieter mit generativer KI verdienen werden; heute wird vor allem viel investiert – eingenommen wird viel, viel weniger: KI ist heute vergleichsweise billig, was – wie die Rechteinhaber sagen werden – genau eins der Probleme ist (es ist daher absehbar, dass sie höhere Preise fordern werden, um selbst besser abgegolten zu werden). Allerdings könnten jene, die auch selbst über Lizenzeinnahmen verhandeln wollen, ihre Inhalte kurzerhand (wirksam) hinter eine Paywall schieben und den Zugang vertraglich regeln. Damit wären sie ebenfalls am Ziel. Gespräche mit Vertretern Schweizer Medienhäuser legen übrigens den Schluss nahe, dass eine Kollektivverwertung aus ihrer Sicht durchaus ein gangbarer Weg sein könnte. Wie andere Kreise dazu stehen, wird sich noch zeigen – ebenso, ob die Schweiz hier überhaupt im Alleingang etwas anrichten kann und soll.

Erweiterte Kollektivlizenz – eine schon existierende Lösung?

Ein weiterer, in der Fachwelt diskutierter Lösungsansatz, der die Idee der Kollektivverwertung konkretisiert, ist das Modell der erweiterten Kollektivlizenzen (im Englischen "Extended Collective Licenses" oder ECL). Dieses Instrument, das im Schweizer Urheberrecht bereits existiert (Art. 43a URG), könnte eine pragmatische Lösung für die komplexen Abgeltungsfragen im KI-Zeitalter bieten. Eine erweiterte Kollektivlizenz erlaubt es einer Verwertungsgesellschaft (wie ProLitteris für Texte und Bilder), Lizenzen für die Nutzung einer grossen Menge von Werken zu vergeben. Das Besondere daran ist, dass die Lizenz nicht nur die Werke der Mitglieder der Gesellschaft abdeckt, sondern auch jene von Nicht-Mitgliedern ("Aussenseiter"). Dies kann das Problem lösen, dass es für einen KI-Anbieter praktisch unmöglich ist, von jedem einzelnen Rechteinhaber im Internet eine Zustimmung einzuholen. Rechteinhaber, die nicht an diesem System teilnehmen möchten, haben jedoch die Möglichkeit, ihre Werke mittels eines "Opt-out" explizit von der Lizenzierung auszuschliessen.

Vertreter aus der Medienbranche scheinen in diesem Modell einen denkbaren Weg zu sehen, um für die Nutzung ihrer Inhalte durch KI-Dienste eine faire Vergütung zu sichern. Das Modell könnte auch für KI-Anbieter Rechtssicherheit und einen zentralen Ansprechpartner schaffen. Die von Kritikern geäusserte Sorge, es sei nicht praktikabel, weil die Rechteinhaber der Inhalte aus dem Internet nicht eruiert werden könnten, ist zwar im Grundsatz richtig, beschreibt aber genau das Problem, für dessen Lösung die erweiterte Kollektivlizenz konzipiert wurde. Die Verwertungsgesellschaften agieren hier treuhänderisch und halten die Einnahmen auch für nicht vertretene Rechteinhaber bereit.

Warum eine Kollektivverwertung auch zur Alibi-Übung werden könnte

Bei kritischer Betrachtung zeigen sich freilich Herausforderungen: Die schiere Masse an online verfügbaren Inhalten übersteigt die bisherigen Anwendungsfälle von ECL und der Kollektivverwertung bei Weitem. Der mit traditioneller Kollektivverwertung verbundene bürokratische Aufwand wird bereits heute mitunter als enorm empfunden, obwohl sich das Repertoire geschützter Werke in den bisherigen Fällen (z.B. Musik) in einem grossen, aber immer noch begrenzten Rahmen miteinander bekannten Stakeholdern bewegt.

Eine Ausweitung auf alle urheberrechtlich geschützten, öffentlichen Inhalte im Internet, selbst wenn dies auf das Territorium der Schweiz begrenzt würde, wirft nicht nur Fragen der Praktikabilität, sondern auch der Wirtschaftlichkeit auf. Es müssten entsprechende Datenbanken aufgebaut werden und da es nicht nur um Text und Bilder geht, wären mehrere Verwertungsgesellschaften parallel am Zug. Es müsste bei Ansprüchen jeweils geprüft werden, ob es sich wirklich um geschützte Werke handelt. Zudem müsste dieser Bereich von anderen, bereits abgegoltenen Nutzungen oder bereits erlaubten Anwendungen abgegrenzt werden, da hier jedenfalls eine ECL keinen Platz hat. Die Kosten für den Unterhalt dieses Verwaltungsapparats würden von den Einnahmen abgezogen (dabei gab der mitunter hohe Verwaltungsaufwand von Verwertungsgesellschaften schon bisher Anlass zu Diskussionen, auch wenn ihnen attestiert wird effizient zu arbeiten).

Eine weitere Hürde ist, dass eine ECL unter heutigem Recht einem Lizenznehmer jeweils einzelfallweise erteilt wird. Jeder KI-Entwickler, der sie will, müsste also jeweils mit der ProLitteris, Suisa und all den anderen relevanten Verwertungsgesellschaften verhandeln (im Bereich der normalen Kollektivverwertung gibt es immerhin "Gemeinsame Tarife"); die ECL ist jedenfalls bisher keine allgemeine Lösung (siehe Beispiele hier).

Schliesslich dürfte die Festlegung eines angemessenen Tarifs eine Knacknuss sein. Wie müsste er bemessen sein? Eine lizenzierte Verwendung kommt gesetzlich bei einer ECL nicht in Frage, wenn sie die normale Verwertung geschützter Werke und Leistungen beeinträchtigt, was aber – wo es um das Problem Nr. 2 geht – aus Sicht von Medienvertretern der Fall sein könnte; hier drückt ja der Schuh. Sie dürften zwar die ersten sein, die sowieso ein Opt-out erklären würden, aber die Regel bedeutet auch, dass eine Entschädigung auf Basis des durch die Nutzung beim Rechteinhaber verursachten Ertragsausfalls in relevanter Höhe heute systembedingt ausgeschlossen wäre. Der Beitrag einzelner Inhalte an die Wertschöpfung globaler KI-Modelle wiederum ist wie gezeigt naturgemäss minim. Wenn jedoch alle Inhalte zusammengenommen lizenziert würden, könnte die Rechnung wieder anders aussehen, aber dann stellt sich die Frage der Verteilung von Mikrobeiträgen an einzelne Rechteinhaber, die sie möglicherweise mangels Relevanz oder Nichtwissen nie einfordern und die treuhänderisch verwalteten Lizenzgebühren kontinuierlich anwachsen.

Gewisse dieser Kritikpunkte könnten natürlich durch eine Anpassung des Gesetzes gelöst werden, etwa in Form einer erweiterten "allgemeinen" Kollektivlizenz als Standardlösung für all jene Inhalte, deren Rechteinhaber nicht aktiv widersprochen haben oder mit alternativen Verwendungszwecken von nicht innert Frist geltend gemachten Einnahmen. Dies müsste zudem mit einem technisch einfachen, maschinenlesbaren Opt-out-Standard kombiniert werden, was die ECL bisher nicht vorsieht; der Opt-out muss dort anders erklärt werden. Allerdings könnten so Rechteinhaber, die individuelle und potenziell lukrativere Lizenzverträge aushandeln wollen, dies weiterhin tun, indem sie ihre Inhalte hinter wirksamen Paywalls schützen und von der Kollektivlizenz ausschliessen. Für alle anderen könnte ein solches System jedenfalls auf den ersten Blick in der Tat eine unkomplizierte und rechtssichere Nutzung durch KI-Dienste gegen eine pauschale Abgeltung ermöglichen.

Ein solches Modell würde sich wohl auch dann aufdrängen, wenn es im Fall der Fälle darum ginge, die Nebenwirkungen einer tatsächlich umgesetzten Motion Gössi zu neutralisieren: Im Gesetz würde zwar die Zustimmung verlangt von allen Rechteinhabern, diese würde jedoch für Inhalte ohne Opt-out von den Verwertungsgesellschaften gegen Entgelt stellvertretend qua neu zu schaffender gesetzlicher Kompetenz pauschal erteilt. Es wäre dies freilich ein gewisser Widerspruch zur Motion, welche gesetzliche Erlaubnistatbestände gerade aufheben will.

Angesichts der gezeigten Herausforderungen stellt sich natürlich auch die Frage nach der Effizienz und Sinnhaftigkeit eines solchen Systems. Der Gesetzgeber könnte zwar behaupten, ein Instrument für einen fairen Ausgleich geschaffen zu haben – was formal auch zuträfe. Wenn jedoch ein grosser Teil der Kreativschaffenden davon nicht profitiert, ist wenig gewonnen; die grossen Player unter den Rechteinhabern werden auch ohne eine solche Regelung zu ihren "Deals" kommen. Es droht letztlich ein "ausser Spesen nichts gewesen". Welche Anbieter unter diesen Umständen an einer solchen Lösung mitmachen würden, müsste sich erst noch zeigen.